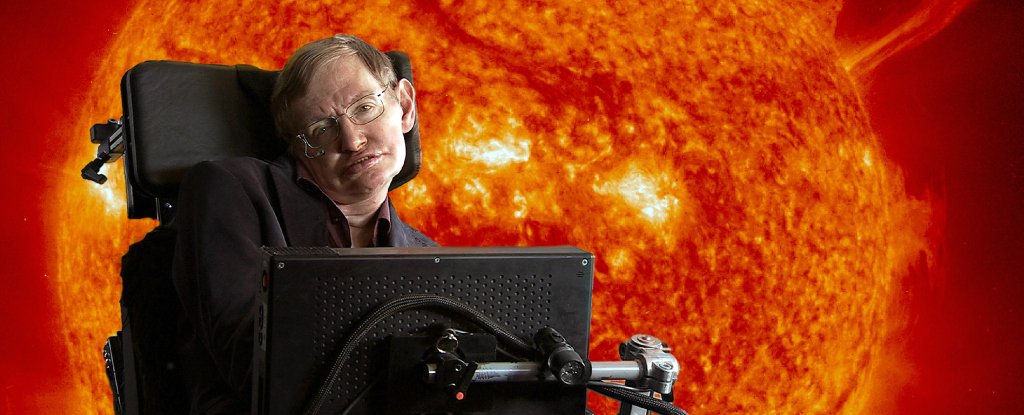

آخرین پیامهای استیون هاوکینگ برای بشر

بیگ بنگ: پیشبینیهای استیون هاوکینگ که تا آخرین لحظه در علم اعلام بازنشستگی نکرد، همواره در صفحه اول روزنامهها چاپ می شد. حالا این سوال در پیش روی ماست که کدام یک از هشدارهای او محتوای فکری عمیقی داشت و کدام یک صرفا نگرانیهای یک دانشمند مشهور بود. اما چه با آن پیشبینیها موافق باشید یا خیر، این پنج هشدار در زیر به آنها پرداخته شده برای چندین سال مورد بحث و بررسی قرار خواهد گرفت.

1-انسان یا در مسیر فاجعه یا ستارهها قرار دارد

1-انسان یا در مسیر فاجعه یا ستارهها قرار دارد

واژههای زیادی برای توصیف استیون هاوکینگ وجود دارد. اما به سختی میتوان صفت «خوش بینی» را به او نسبت داد. هاوکینگ در سال 2016 گفته بود: «ما با چندین تهدید روبرو هستیم: جنگ هستهای، گرمایش جهانی و ویروسهای دستکاری شده ژنتیکی. اگرچه احتمالا بروز یک فاجعه در سیاره زمین در سال ای آینده می تواند بسیار پایین باشد، اما این احتمال با گذشت سالیان افزایش می یابد و در هزار یا ده هزار سال بعد به واقعیت خواهد پیوست.»

به باور هاوکینگ، سرنوشت انسان برای تبدیل شدن به گونههای مسافر فضایی است. البته به شرطی که در قرن آینده خودمان را به نابودی نکشانیم. او افزود: «اما احداث سکونتگاههای دائمی در فضا تا 100 سال آینده برای انسان مقدور نخواهد بود. ما باید در این بازه زمانی مراقب و هوشیار باشیم.»

2-باید برخیزیم و قدری بیشتر حرکت کنیم

هاوکینگ با مطالعه چیزهایی با جرم عظیم یعنی «سیاهچالهها»، اثر جاودانهای بر علم گذاشت. اینکه چنین گام ِ بزرگی او را شایستۀ تبدیل به سخنگویی بر علیه چاقی کرده است یا خیر، همچنان جای بحث دارد. اما او در سال 2016 طی یک سخنرانی به بررسی مسئله جدی افزایش چربی دور کمر پرداخت. آقای هاوکینگ در تبلیغ ویدئویی شرکت سوئدی «GEN-REP» گفت: «امروزه افراد بسیار زیادی در اثر عوارض ناشی از چاقی و اضافه وزن جان خود را از دست می دهند. ما غذای زیادی مصرف می کنیم اما میزان تحرک خیلی پایینی داریم.» بر طبق این تبلیغ، باید کمتر بخوریم و هر روز حداقل نیم ساعت تحرک فیزیکی داشته باشیم.

3-هوش مصنوعی جای همۀ ما را خواهد گرفت

3-هوش مصنوعی جای همۀ ما را خواهد گرفت

زمان سیطرۀ انسان بر کره زمین بزودی تمام خواهد شد. بدتر از همه اینکه، شاید از نقطه بدون بازگشت عبور کرده باشیم. هاوکینگ سال 2017 در مصاحبهای با مجله «Wired» هشدار داد: «دیگر نقطۀ بازگشتی وجود ندارد. ترس من این است که هوش مصنوعی بر جایگاه انسان تکیه خواهد زد.» بهترین راهکار این است که استفاده از هوش مصنوعی در مقاصد نظامی را ممنوع اعلام کرده و توجهمان را به اینکه چگونه مشاغلمان را تصاحب می کند، معطوف کنیم. آیا این بدان معناست که اگر هدفمان حرکت به سوی ستارگان باشد، باید این کار را بدون کمک از هوش مصنوعی انجام دهیم؟ بحث در این مورد هنوز ادامه دارد.

4-احتمالا موجودات فضایی تمایلی به دوستی با ما ندارند

همچنان که بر روی مسائل زیست محیطی کار می کنیم، هوش مصنوعی را به طور جدی هوشمند نمی کنیم و در حال پای گذاشتن بر مریخ هستیم، باید زیاد سر و صدا نکنیم. هاوکینگ متقاعد شده بود که موجودات فضایی وجود دارند. هاوکینگ در فیلمی تحت عنوان «جاهای مورد علاقه هاوکینگ» در سال 2016 گفت: «من روز به روز به این مسئله اطمینان بیشتری پیدا می کنم که انسان در کیهان تنها نیست.»

اگرچه او اشتیاق زیادی برای کمک به ما در یافتن موجودات فضایی داشت، اما زیاد مطمئن نبود که آیا باید به این زودی به طور گرم با آنها دست بدهیم یا خیر. هر گونهای که با آن روبرو شویم، به احتمال زیاد فناوری بسیار پیشرفتهای خواهد داشت. هاوکینگ هشدار داد: «اگر این چنین باشد، آنها قدرت مافوق تصوری خواهند داشت و ما را موجودات بیارزشی قلمداد خواهند کرد.»

5-با این سرعتی که ما می رویم، کارشناسان منقرض خواهند شد

5-با این سرعتی که ما می رویم، کارشناسان منقرض خواهند شد

خب، باشه! او هرگز از واژه «انقراض» استفاده نکرد. اما می دانیم که منظورش همین بود. او در یک سخنرانی در مارس 2017 مدعی شد: «ما شاهد یک شورش جهانی علیه کارشناسان هستیم.» در حالیکه خبرهای کذب به خبرهای بزرگی در رسانهها تبدیل می شوند، هاوکینگ ما را تشوبق به گوش دادن به حرف کسانی کرد که زمان ِ خود را صرف مطالعۀ مسائل علمی می کنند. هاوکینگ به حضار گفت که راه حلهای مربوط به چالشهای زیست محیطی و تهدید بالقوه هوش مصنوعی تنها با علم و فناوری به دست خواهند آمد.

ترجمه: منصور نقی لو/ سایت علمی بیگ بنگ

منبع: sciencealert.com

(36 نفر , میانگین : 4,50 از 5)

(36 نفر , میانگین : 4,50 از 5)

ابدا در مورد هوش مصنوعی و کامپیوترهایی هوشمند و رباتیک اشتباه نمیکردند آقای هاوکینگ و شک ندارم من هم که کافی هست به واقع قدرتمند تر از کل اینترنت شبکه ای نظامی ایجاد گردد با هوش مصنوعی و کنترل تسلیحات هسته ای را نیز ضمیمه ی آن کرد بدون کوچکترین اغراقی عینا داستان فیلم های سینمایی مثل ترمیناتور (نابودگر) و یا فیلم سینمایی مرد آهنی، عصر آلتران اتفاق خواهد افتاد… و این یعنی فاجعه برای تمدن انسانی.

خیلی هم خودمون رو دست بالا نگیریم چون در مقایسه با عمر سیاره ی زمین و حوادث فاجعه بار اگر ما تمام سلاح های هسته ای دنیا رو یکباره استفاده کنیم.. پس از ما باز هم زمین به حیات خود ادامه خواهد داد چون فجایعی عظیم تر را در طول حیات خود تجربه کرده در این چهار میلیارد و ششصد میلیون سال و هنوز همینجاست…

حال آنکه گونه ی انسان هوموساپینس ؛ یعنی خود را تافته ی جدا بافته بدانیم و جدا کنیم از زمین، دقیقا حتی تمامی رشته کوه ها و کل شکل ظاهری پوسته ی قاره ها مثل دشت ها و صحراها و کوه ها عمری 2 میلیون ساله دارند… و متفاوت از فرضا بیست میلیون سال قبل. و تنها صخره های گرند کنیون شامل تنها این دو میلیون سال نیست…

شاید حتی آگاه نباشیم که زمین ما را نیاز داشت برای تولید پلاستیک و یا پلوتونیوم! (شوخی) که در جهان هستی بظاهر نایاب هستند!! و زمین نمی توانست به تنهایی تولید کند آن را… !!!

در محاسبات ریاضی سود بخش برای اکوسیستم زمین، اصلا نبود ما بسیار مفیدتر از بودن ما است. و اگر زمین دارای روحی باشد متعالی مثل همان (گایا) آیا انقراض ما را انتخاب نخواهد کرد در نهایت ؟!

گرچه من جدایی از این نظرات علمی و شبه علمی متفاوت، به شدت معنوی به قضیه ی حضور انسان در زمین می اندیشم و معتقدم گونه ی انسان نه در فرایند تکاملی در زمین از انسان نماها بلکه از مکانی دیگر به این سیاره نقل مکان کرده طی حداکثر 200 هرار سال گذشته… در غیر اینصورت فرایند تکامل و هوش و خودآگاهی کامل فقط به انسان اختصاص نداشت و گربه و سگ ما هم امروز یک موبایل یا تبلت و لپ تاپ در مقابلش بود!

در واقع ما خود یکی از بیگانگان فضایی هستیم و بی خبر از آن و یا بقول برخی آزمایشی خاص توسط بیگانگان فضایی و شکی ندارم شخصا در بخش اول این تفکر و تفسیر شخصی…

به هر صورت ممنون دوست جان. جالب بود. ???

با سپاس…

با درود عالی بود متشکرم

به نظر من حق با هاوکینگ بزرگه

شاهد بودیم که چندی پیش فیسبوک دوتا ربات هوش مصنوعی که برای خودشون زبان اختراع کردن رو خاموش کرد به نظر من این اولین چالش انسان در مواجهه با چنین مسیله ای میتونه باشع باید استفاذه از هوش مصنوعی در تجهیزات نظامی منع بشه هرچند کسی توجه نمیکنه

بله هوش مصنوعی در ساخت تجهیزات نظامی و ابر سربازان رباتیک واقعا خطرناک

ولی خیلی از پیش بینی ها هم دقیقا همون نخواهد شد و این کاملا طبیعی

عالی بود، لذت بردم، ممنون

با درود فراوان لطفا مستند مکان هایه مورد علاقه هاوکینگ رو تو برنامه هاتون داشته باشید .

هوش مصنوعی فقط از دید بازار کار و اقتصادی و عملکرد اجتماعی شاید بتونه از انسان بهتر باشه قبول دارم

ولی از دید فلسفه و علوم شناختی و خودآگاه بودن و ذهن خیر چون انسان هنوز خیلی چیزها نمی دونه از عملکرد مغزی و ذهنی

ما هنوز دلیل قطعی پیدا نکردیم که چرا زنده ایم

منشا خودآگاهی ما از کجا نشات میگیره

پله عشق و عواطف چرا اینقدر حساس و شیرین

پس پیشی گرفتن هوش مصنوعی از انسان تعریف های متفاوتی داره و دیدگاه های مختلف

من قبول دارم هوش مصنوعی در خیلی از کارها از انسان جلو خواهد زد ولی این به این معنی نیست که بشه خودآگاهی و ذهن و خلاقیت و اندیشه و احساسات برنامه نویسی کرد.به قول میگوئل نیکولیس عصب شناس معروف دوک آمریکا هیچگاه خودآگاهی نمیشه برنامه نویسی کرد

عشق نمیشه مجازی دید و نوشت

خلاصه اینکه هرکسی پیشرفت های هوش مصنوعی از دریچه ذهنی خودش می بینه و قرار نیست همه پیش بینی ها درست از آب در بیاد

باتشکر